近日,特斯联首席科学家、特斯联国际总裁邵岭博士及其合作团队发表最新研究成果,探索将卷积神经网络(ConvNets)的优势与Transformer架构相结合的并行设计方法。该研究成果可广泛应用于多模态学习、图像分类、图像分割、图像检索等场景,并能够有效提升模型在计算机视觉任务中的性能、提供更佳的灵活度,改善医疗诊断、自动驾驶等现实场景的感知能力及分析能力,为深度学习模型的设计提供了全新的思路。目前,这一研究成果已被人工智能领域顶级学术期刊IEEE T-PAMI收录,题为:Dynamic Unary Convolution in Transformers。

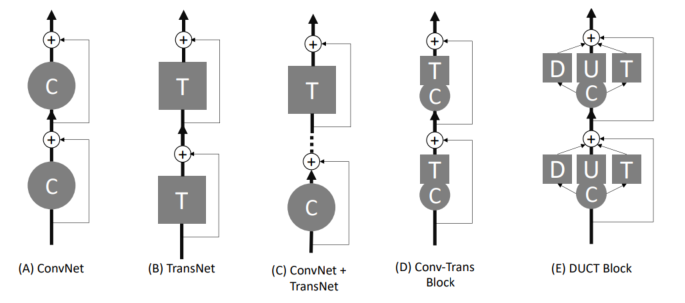

现有卷积神经网络架构(A)和Transformer架构(B)以及团队所提出DUCT(Transformer架构中的动态一元卷积神经网络)块对比图。尽管此前的研究将卷积及Tranformer层以(C)集成,近期的趋势为以块状方式交替Transformer和卷积神经网络(D)。团队所提出的DUCT(E)为并行架构,在块状设计中结合了动态局部增强模块、一元共现激励模块和多头自注意力。

以下为论文摘录。

当前,关于Transformer架构是否有能力补充卷积神经网络,尚无确切定论。近期的一些尝试通过一系列架构,将卷积与Transformer设计结合起来;而本论文的研究成果聚焦于探索一种并行设计方法。

尽管此前基于Transformer的方法需要将图像分割成块状单元,团队观察到在卷积特征上进行的多头自注意力(multi-head self-attention)主要对全局关系敏感,而当这些关系没有显示时,多头自注意力性能将会下降。因而,团队提出以两个平行模块以及多头自注意力来增强Transformer。

具体而言,在该研究中:

·团队首次尝试在混合Conv-Trans(卷积-Transformer)块中整合并行结构。

·引入了一个动态局部增强模块(Dynamic Local Enhancement, DLE),用于保留高度信息性的局部区域信息。

·提出了一个全新的一元共现激励模块(Unary Co-occurrence Excitation, UCE),通过在局部区域间寻找位置不变的共现关系,增强模型对局部特征的捕捉能力。

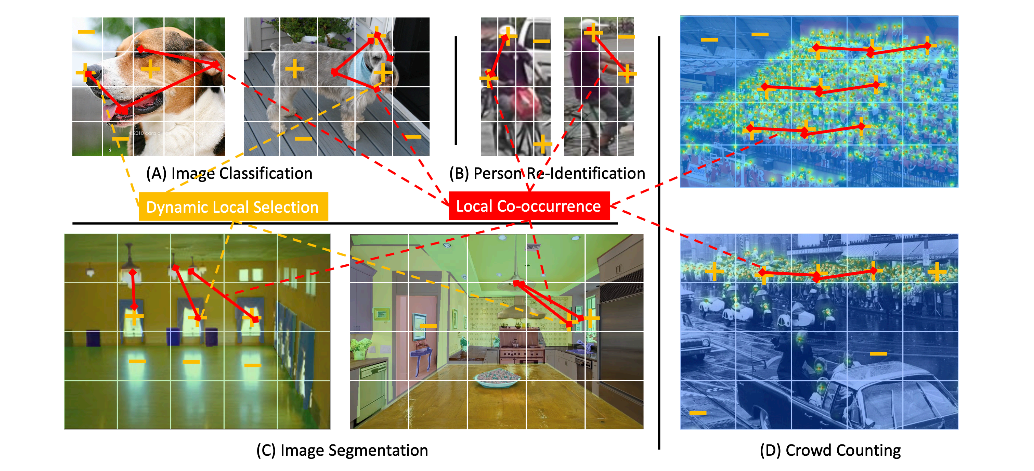

团队所提出的动态局部增强模块(DLE)和一元共现激励模块(UCE)在不同的计算机视觉任务中的示意图。DLE旨在为卷积(以橙色显示)的重要局部区域分配权重。UCE搜索局部区域与其它区域之间的独特共现关系。这种在特征图层面的共现可以实现更高的不变性。DLE、UCE和多头自注意力结合起来,以互补的方式检测局部、中层和全局信息。

并行设计的Transformer架构中的动态一元卷积神经网络(DUCT)块被聚合成一种深层架构,该架构在基于图像的分类、分割、检索和密度估计等基本计算机视觉任务中进行了全面评估。定性和定量结果均表明,团队所提出的具有动态一元卷积的并行Conv-Transformer方法,优于现有的串联设计结构。

DUCT的提出在学术上推动了Transformer和卷积神经网络的融合,在实际应用中亦具有广泛潜在价值,有助于推动计算机视觉技术的发展和创新。在图像分类方面,DUCT能够处理图像并将其分类到不同的类别中,这对于图像识别、内容分析和检索等任务至关重要;在图像分割中,在医学成像、自动驾驶和机器人视觉等领域,DUCT可辅助将图像划分为多个区域对象,以便于进一步分析;在图像检索中,DUCT可用于改进图像检索系统,如通过物体识别来搜索特定图像或视频帧;在多模态学习领域,由于DUCT结合了卷积和自注意力机制,其可应用于处理和分析多种模态的数据,如图像、文本和音频。

未来,特斯联将进一步夯实其在AIoT领域的技术研发能力,在实现前沿突破的同时,亦为深入行业的应用创造全新可能性。

渝公网安备 50010302002747号

渝公网安备 50010302002747号